AI虚假信息泛滥

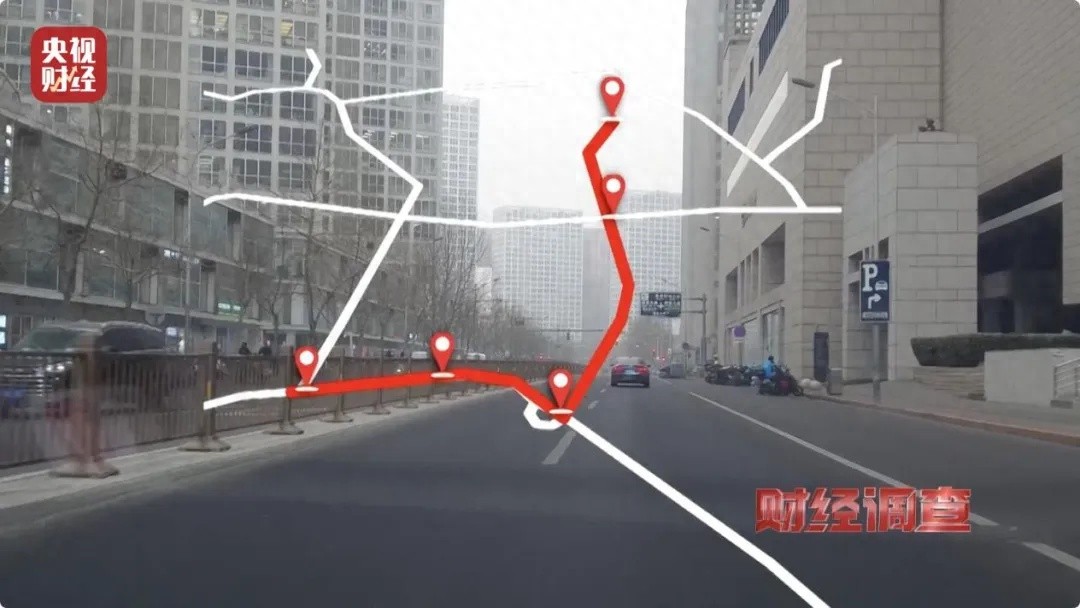

当前,人工智能技术迅猛进步,由此产生的虚假信息问题愈发严重。这些虚假信息具有极高的迷惑性和传播速度,对信息的真实性构成严重威胁,同时也干扰了社会秩序和公众认知。以近期西藏地震为例,灾后网络上便出现了多起利用AI技术构建虚假灾害场景的事件。

平台重拳出击

抖音平台对相关现象作出快速应对,对23652条涉及地震的虚假信息进行了严肃处理。这些处理举措体现了平台确保网络信息真实性的坚定意志。然而,这也暴露了当前AI生成虚假信息的普遍问题,单就一个平台而言,就有大量不实信息亟待处理。

公众高度关注

公众对AI技术滥用及网络虚假信息治理问题表现出强烈关注。舆论普遍认为,虚假信息的广泛传播侵犯了公众的知情与选择权利,扰乱了市场公平竞争的秩序,社会各界普遍期待一个真实、健康的网络空间。

多重危害显现

AI生成的虚假信息对多方面造成严重影响,它不仅可能损害知识产权,挑战版权制度,还可能侵犯个人隐私,泄露身份数据,甚至面临被滥用的可能,对社会各领域构成潜在威胁。

提案提出建议

针对该问题,提案提出了多项建议。首先,需加强法律规范构建,健全法律框架,严格执行现行法规,确立责任主体,这样才能在法律层面上为AI虚假信息的治理提供支撑。

具体实施路径

技术监管领域需构建检测与识别技术架构,并强化内容标签管理。应研发并运用检测算法,对AI生成内容进行实时监控,以便迅速发现并处理虚假信息。此外,对网络服务提供商实施严格的内容标签规范,确保用户能够明确辨识。互联网平台必须强化内容审查流程。需组建专门的审核小组。运用技术手段如过滤和屏蔽来阻断虚假信息。同时,对未能履行职责的平台依法进行惩处。这些措施旨在确保网络环境的秩序井然。