在数字化浪潮中,AI剧情聊天软件逐渐崭露头角,然而,这些软件在青少年模式下的内容审核存在明显缺陷,这一现象引发了广泛关注。这不仅关乎青少年身心的健康成长,同时也暴露了平台监管的不足,亟待解决,成为当前迫切需要面对的问题。

AI剧情聊天软件现状

目前,市场上众多AI剧情聊天软件受到欢迎。此类软件普遍宣称具备先进功能及青少年模式,旨在对青少年使用进行管控。但实际情况却是,在数据与算法的支撑下,这些软件看似强大,实则未能有效保障青少年安全。据数据显示,大量此类软件涌入市场,声称提供多样化服务,众多青少年对此类软件用于娱乐或社交表现出浓厚兴趣。

此外,AI聊天网页亦受到广泛青睐,这一现象不限于App领域。这类网页在开发时普遍将用户体验置于首位,但对于青少年保护的关注不足。以繁忙且竞争激烈的网络环境为例,多数聊天网页并未设置针对未成年人的特定模式,即便有设置,也往往流于形式。

青少年模式形同虚设

众多平台宣称设有青少年保护模式,然而记者调查揭露,这些模式往往形同虚设。在部分平台上,未成年人能够轻易规避限制措施。以手机端为例,一些App虽设有限制内容和使用时间等保护措施,但身份验证机制并未有效运作。因此,青少年能够轻易接触到一些不适合他们年龄的边缘性对话内容。

网页端的情况尤为严重,根据记者对7款AI聊天网页的试用情况分析,大多数网页并未启用青少年模式。即便部分网页已设置此模式,实际效果却微乎其微。例如,用户在选“否”后,仍能访问包含不良标签的角色分类。

网页体验的便捷与隐患

家长在接受采访时表示,相较于应用程序,网页版的AI聊天服务在操作上更为简便,且青少年群体更易接触。多数网页仅需简单几步操作即可开启对话。以登录页面为例,仅需进行注册或通过第三方平台登录,无需经历严格的年龄审核流程。

网络普及带动了未成年人获取信息的途径增加。他们仅需进行基础搜索,便能轻易访问到AI聊天网站。这些网站普遍缺乏有效的监管措施,导致大量不适宜青少年接触的内容得以广泛传播,对孩子们的身心健康造成了负面影响。

内里是换汤不换药

业内专家指出,所谓的AI剧情聊天,实则只是将过去的互联网“语擦”技术换上了人工智能的新装。这一现象表明,聊天内容的本质并未发生显著变化,过往的风险依然存在,且因新技术的掩饰,风险可能被忽视。在互联网聊天中曾出现的灰色、不良内容,同样可能在AI剧情聊天软件中重现。

技术创新背后的问题

此类软件依托大模型技术迅速崛起。大模型技术不仅催生了创新与灵活性,但也带来了不可预测性和潜在风险。比如,内容生成可能偏离正确方向,甚至产生不良内容。正如记者调查揭示的不良标签所示,这一问题已显现。尽管技术不断进步,但在评估内容适宜性方面,仍存在一定的滞后性。

实际体验表明,在使用此类软件时,用户可自行设计虚拟角色的形象与风格。系统根据用户输入生成相应形象,然而,目前尚无对潜在不良诱导的评估机制。若此趋势持续,自动生成功能可能引发更多不当内容的产生。

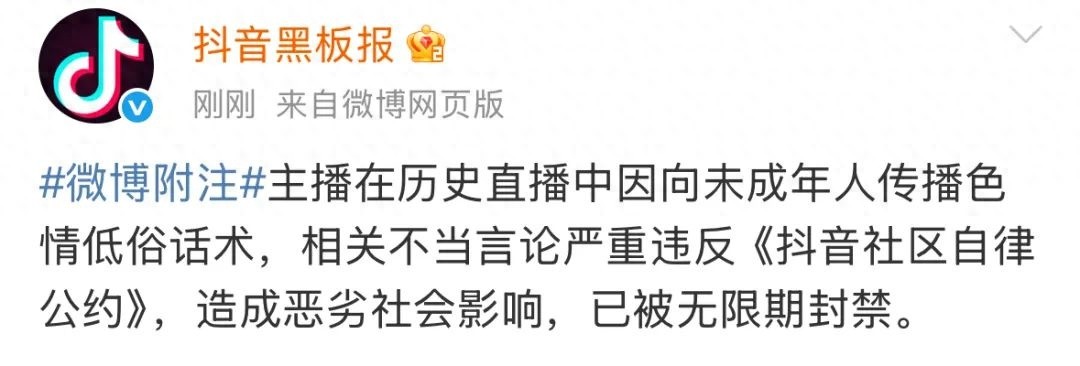

审核强化势在必行

专家指出,对于AI剧情聊天软件,尤其是青少年专用版本,必须加强内容审查流程。这要求技术具备有效筛选并拦截不适宜对话的能力。正如朱巍所强调的,对于不适宜未成年人使用的应用,应从应用分发平台和移动设备层面实施限制,以避免未成年人下载。

家长对于已下载的应用程序,理应开启青少年模式并控制使用时长。然而,正如刘晓春所言,内容生产环节同样至关重要。这不仅要求算法进行自动审查,更需要专业团队进行监管与调整,以避免技术漏洞导致不良内容的产生。

在此,提出一个问题供广大读者思考:在防范AI剧情聊天软件不良内容对青少年造成影响的问题上,平台与家长的责任究竟谁更重大?我们期待着各位读者的积极参与,发表评论,并点赞及分享这篇文章,以促使更多人关注这一紧迫议题。